1 はじめに

1.1. Diffusion Model とは?

1.2. 先行研究 (Biroli et al., 2024)

1.3. 本論文の要旨

A Blog Entry on Bayesian Computation by an Applied Mathematician

$$

$$

1.1 Score-based Diffusion Models

\text{Forward}\quad dX_t=-X_t\,dt+dB_t,\quad X_0\sim P_x, \text{Reverse}\quad dX'_t=-\biggr(X_t'+2s_t'(X_t')\biggl)\,dt+dB'_t.

ただし s_t'(x):=\nabla_x\log p_t'(x) は (X_t') の周辺密度 p_t' の Hyvärinen スコア.

\Delta_t:=\sqrt{1-e^{-2t}} とすると \xi:=\frac{X_{s+t}-e^{-t}X_s}{\sqrt{\Delta_t}}\sim\operatorname{N}(0,1).

s\to\infty を考えて,次の損失関数が発想される: \mathcal{L}_t(\theta;\{x^\nu\}_{\nu=1}^n)=\frac{1}{n}\sum_{\nu=1}^n\operatorname{E}_\xi\left[\|\sqrt{\Delta_t}s_\theta(x_t^\nu(\xi))+\xi\|^2\right].

ただし,x_t^\nu(\xi):=e^{-t}x^\nu+\sqrt{\Delta_t}\xi.

1.2 Generation from the Empirical Score

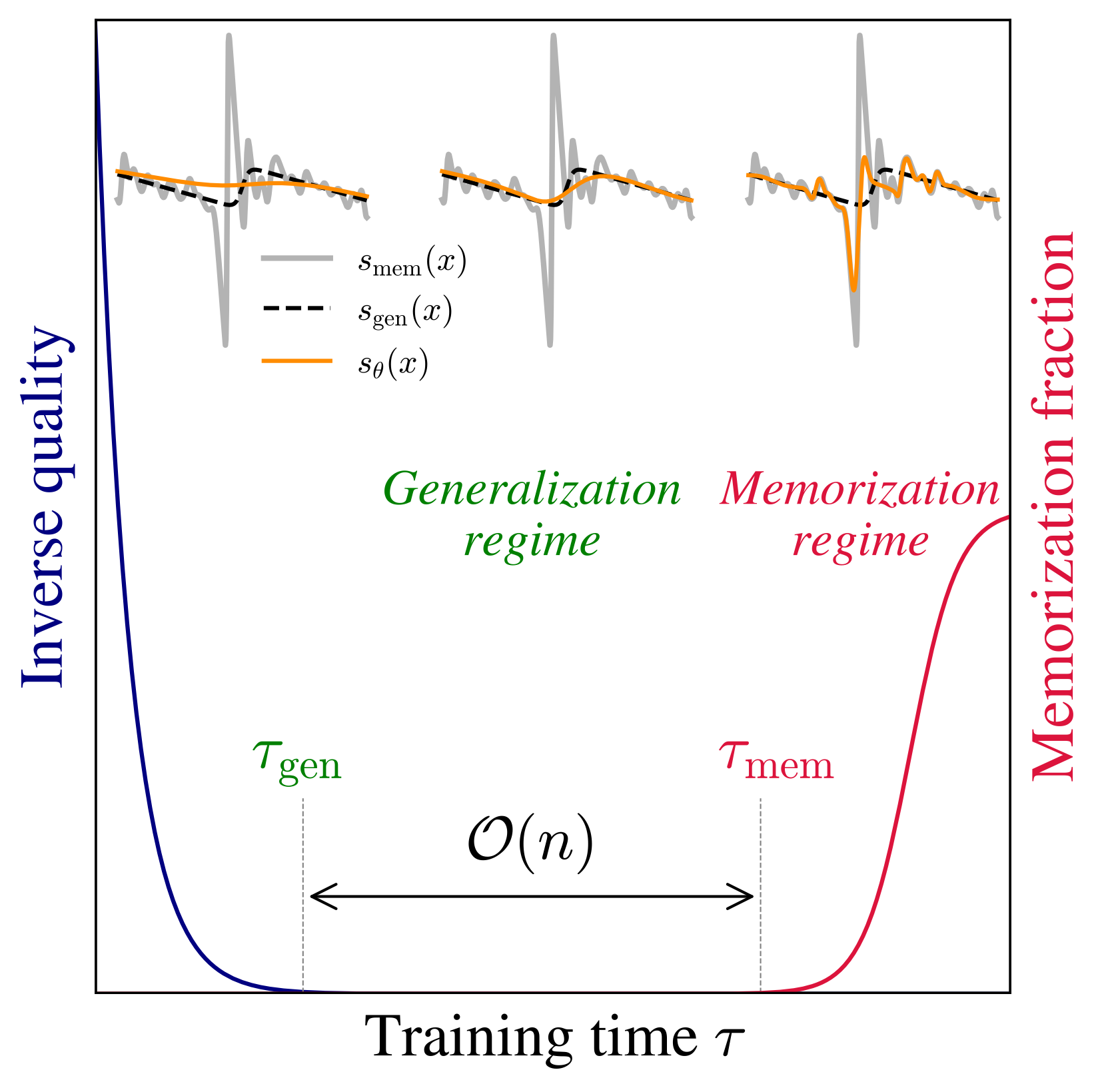

Early stopping により汎化を達成しているのでは?

不完全なスコア学習+サンプリングでの数値誤差で汎化している???

n=O(e^d) で大きくすると memorization が起こる時刻は \tau_C\to0 に近づく (Biroli et al., 2024): \tau_C=\frac{1}{2}\log\left(1+\frac{\sigma^2}{n^{\frac{2}{d}}-1}\right)

1.3 本論文の要旨:Implicit Dynamical Regularization

- たしかに解き切っていない.汎化のためには early stopping が必須.

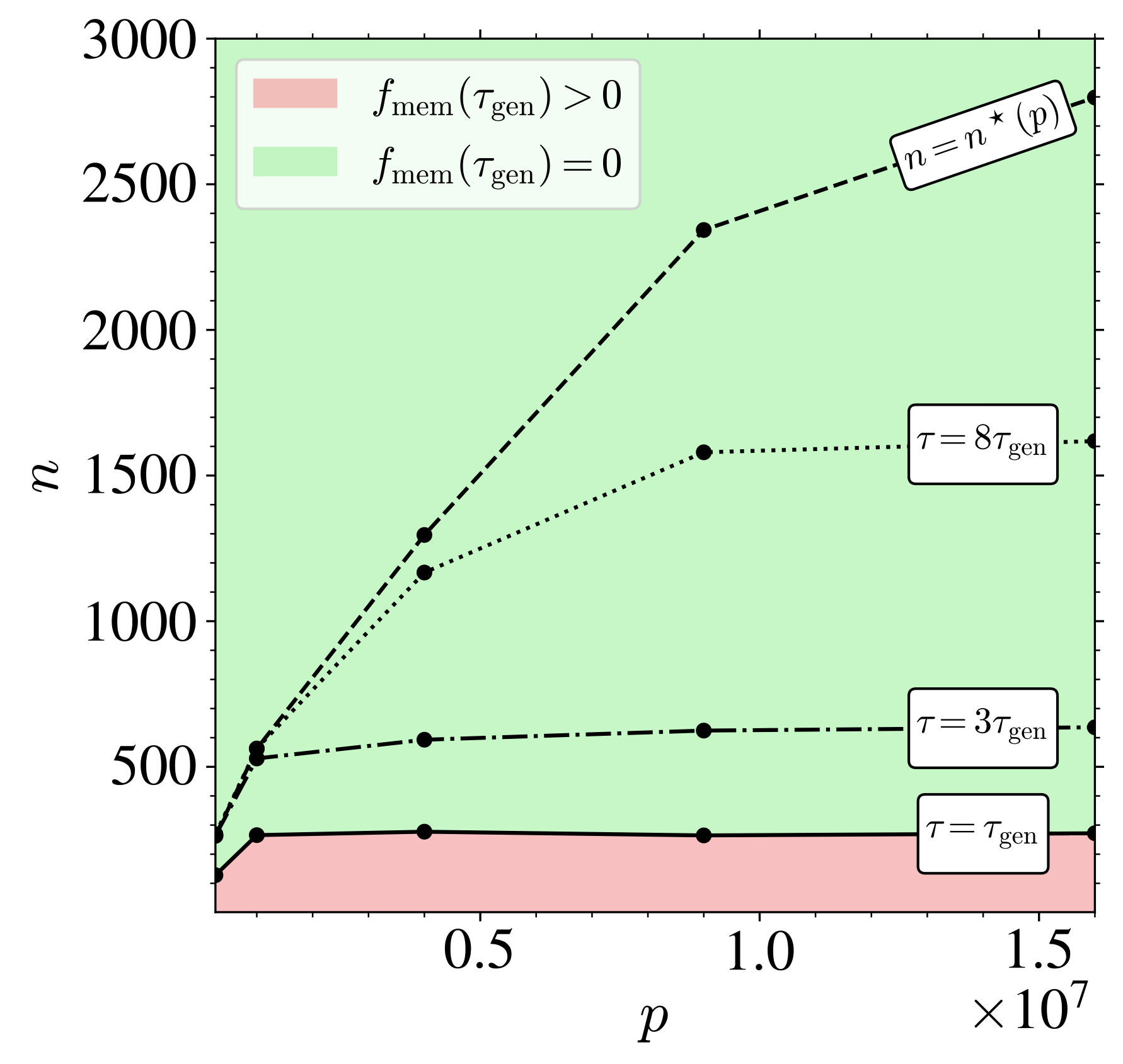

- n<p じゃないと implicit dynamical regularization は起きない.

- p<n のとき,訓練ダイナミクスにスケール分離が見られる

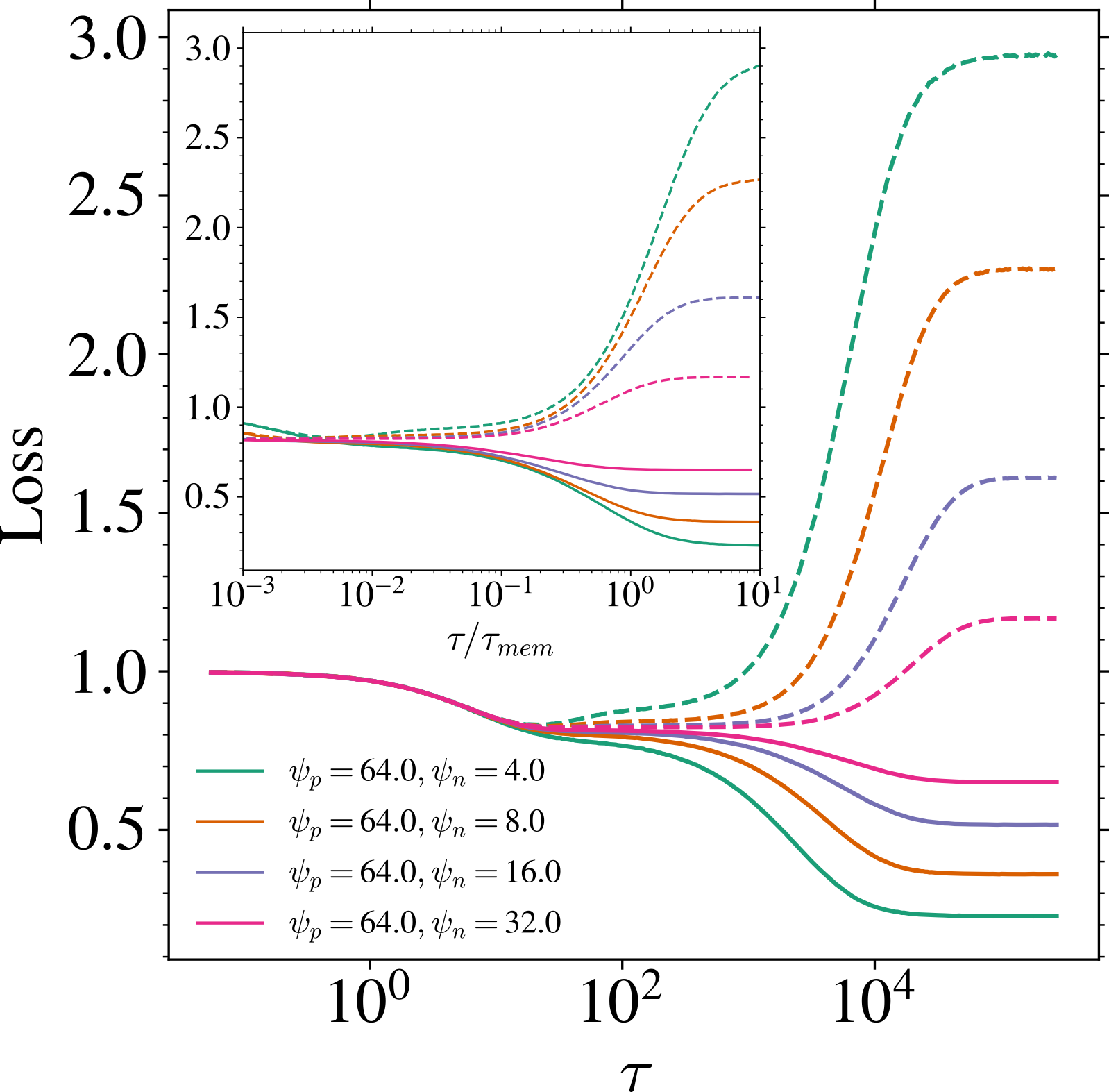

汎化が始まる時間は \tau_{\text{gen}}=O(1) だが,過学習が始まる時間は \tau_{\text{mem}}=O(n)

→ n が大きいほど early stopping の sweet spot が広い.

2 実験パート (Section 2)

理論パートではスコア学習に特化して解析するので,

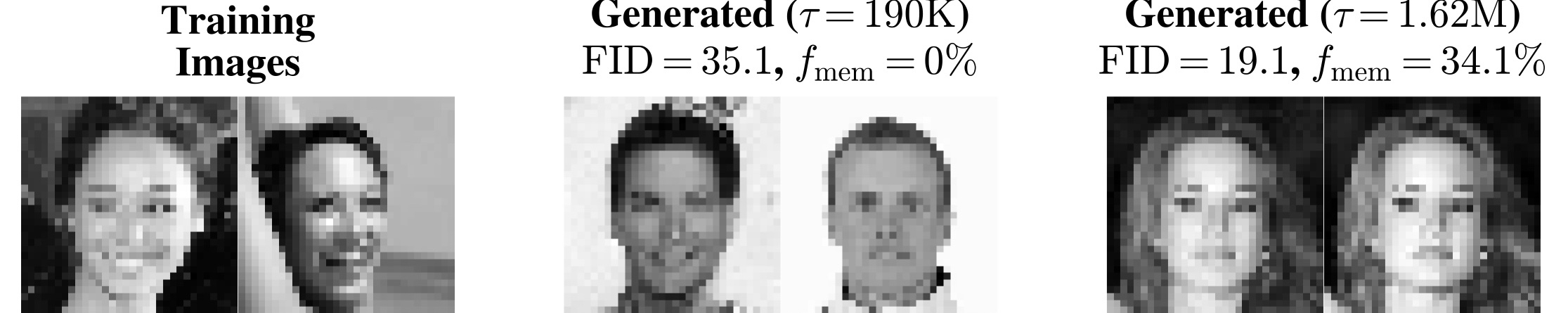

\text{スコア学習での汎化}\,\approx\,\text{Generative Model としての汎化}

を確認する必要がある (2.2).

2.1 設定

- データ:cropped, grayscaled, & downsampled CelebA, d=32^2

- スコア学習に使う NN:U-Net, 時刻 t は sinusoidal position embedding

- 損失関数:DDPM loss.ここまで全て (Ho et al., 2020) の設定に従う.

- 訓練:SGD, momentum \beta=0.95, \eta=0.01, B=n\land512

n\in\{128,\cdots,32768\}, p\in\{1/4,1,2,4,9,16\}\times10^6 を順に動かしていく

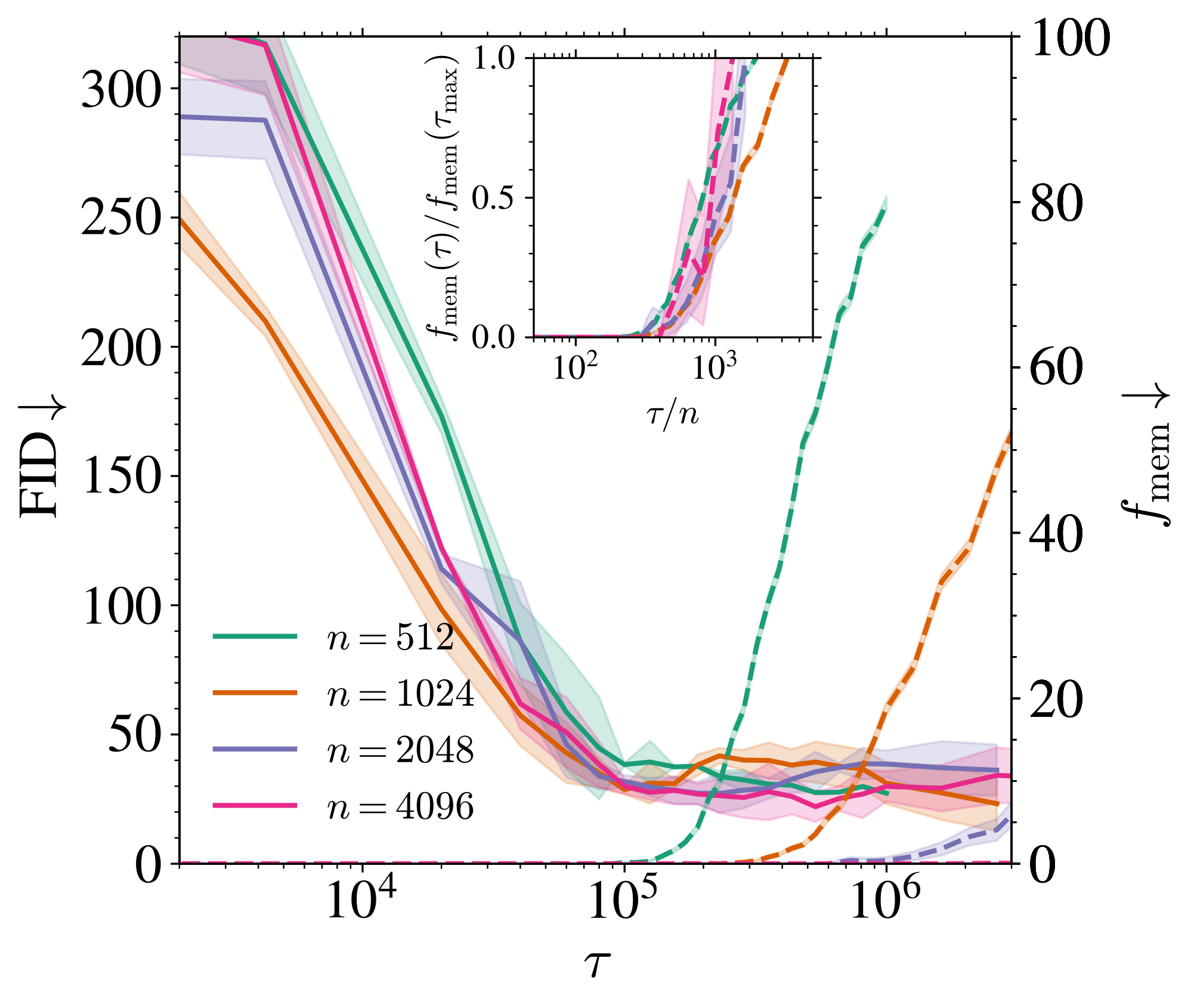

2.2 データサイズ n を変える

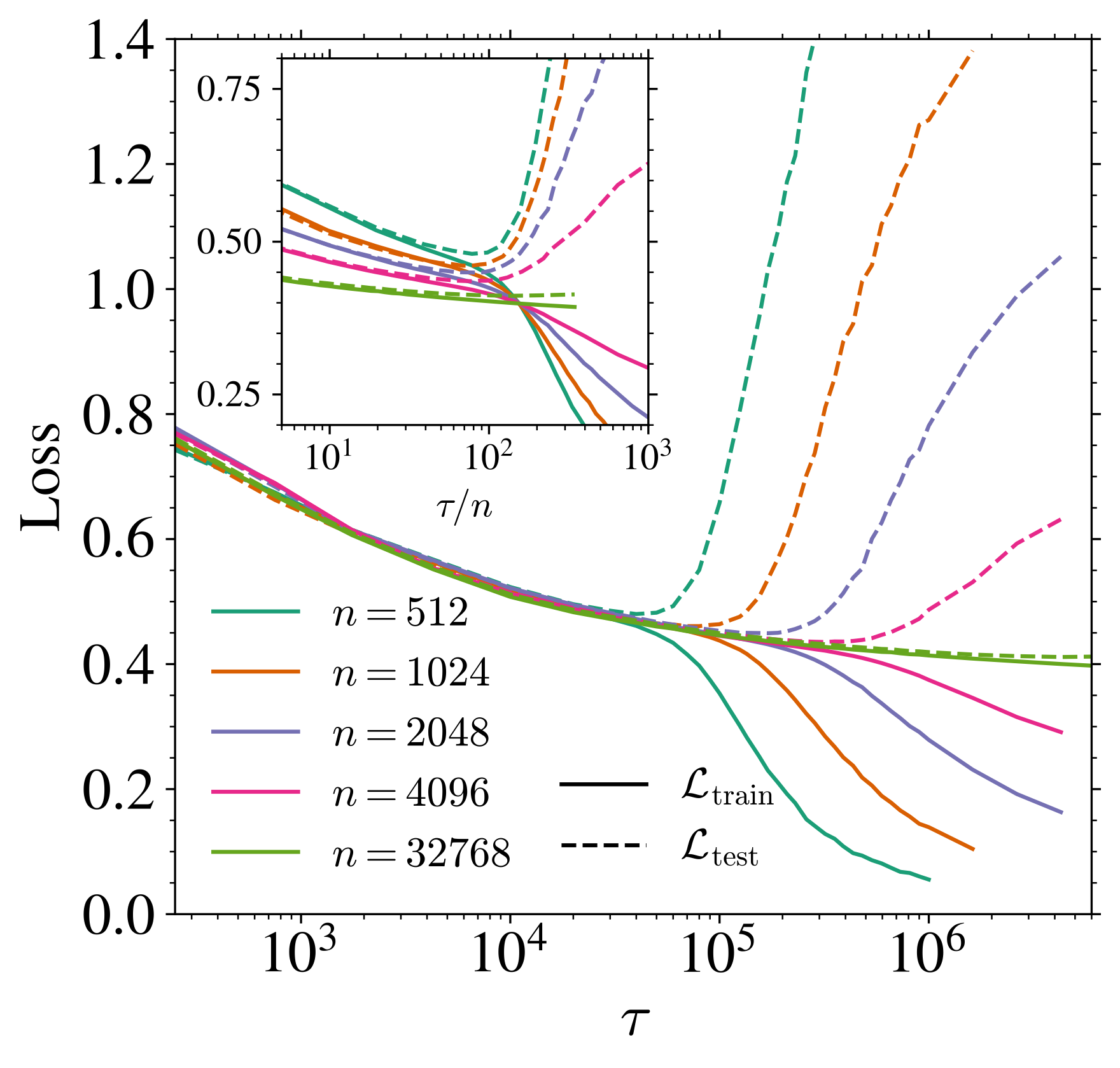

訓練誤差(実線),テスト誤差(点線).全て t=0.01.

- n が増えるほど汎化ギャップ \mathcal{L}_{\text{gen}}=\mathcal{L}_{\text{test}}-\mathcal{L}_{\text{train}} が小さくなる.

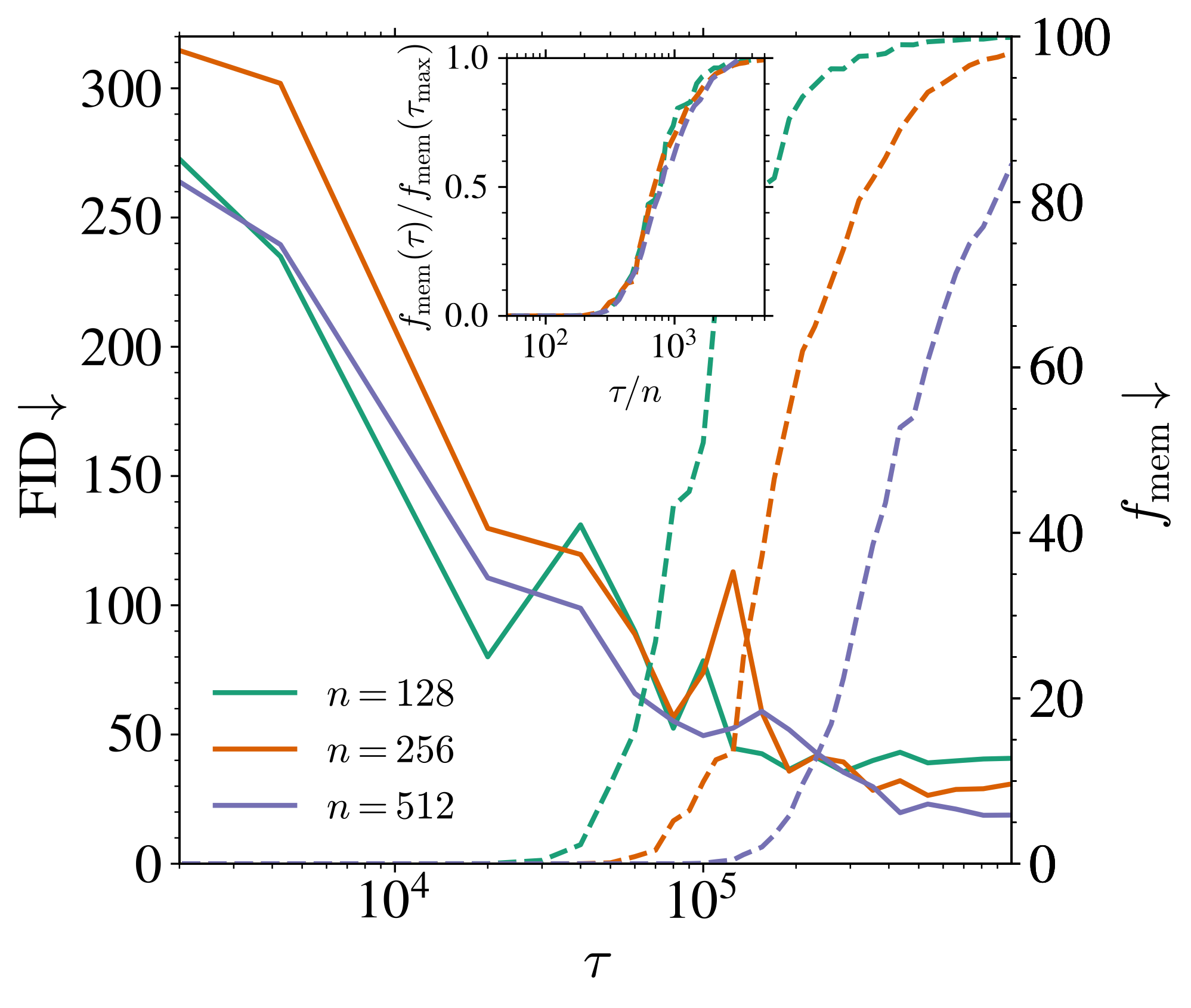

- \mathcal{L}_{\text{gen}}>0 が始まって,少し遅れて f_{\text{mem}}>0 が始まる.が,スケーリングは同じ.

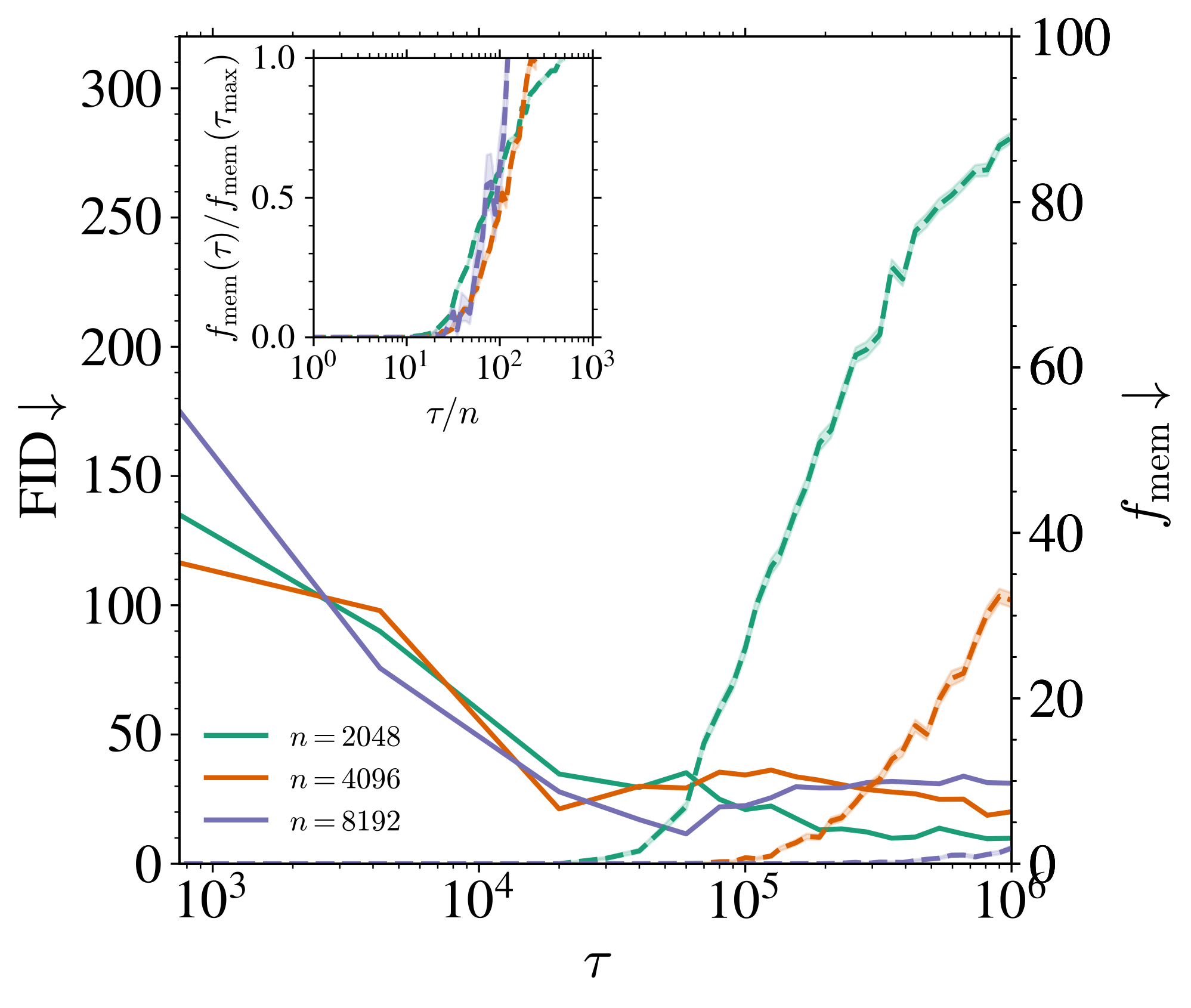

2.2 データサイズ n を変える

それでも同じスケーリングが見られる

→ 「モデルにサンプルを見せた回数」に依らない現象

\tau_{\text{gen}},\tau_{\text{mem}} が全体的に小さい方向へスライド

主要なスケーリングは変わらない

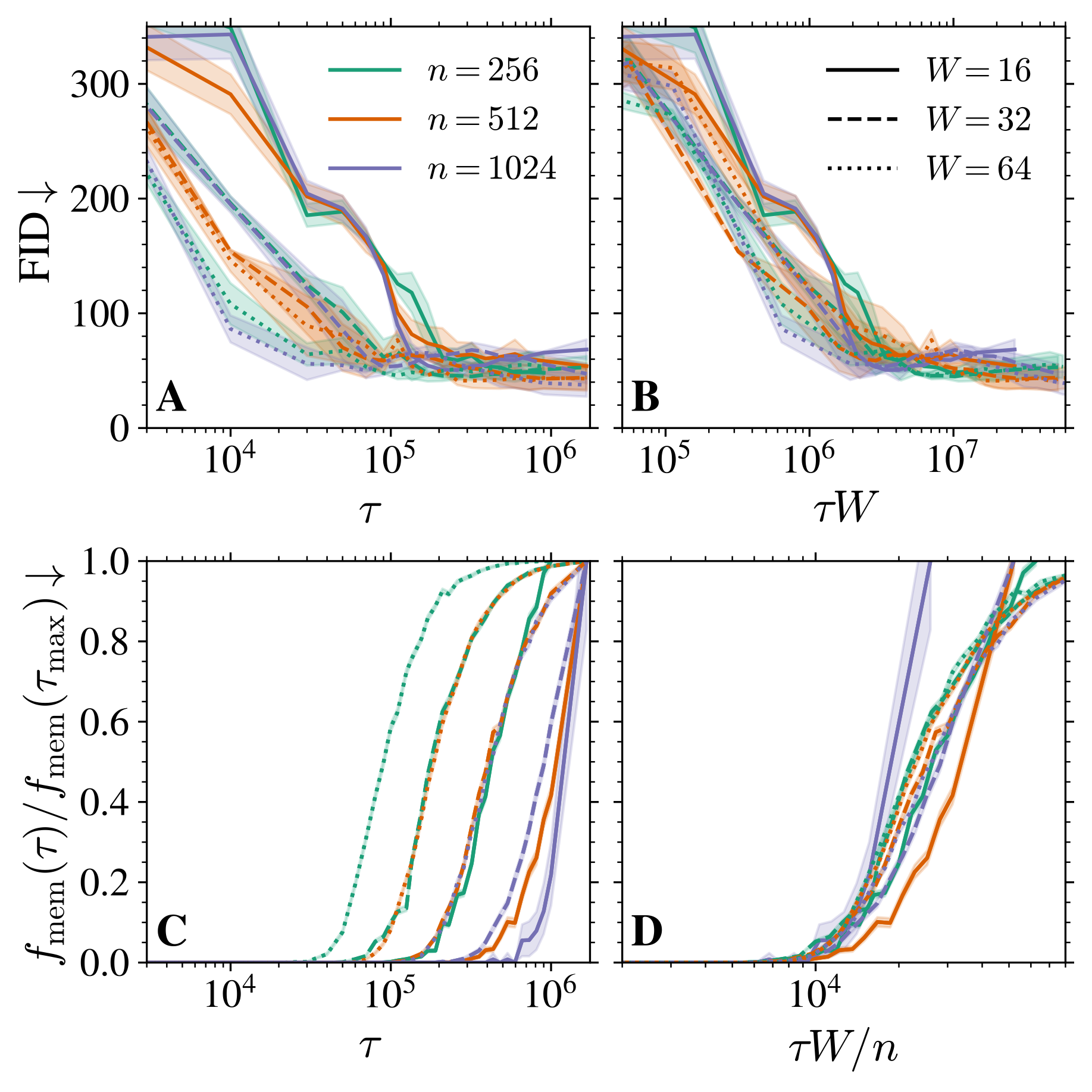

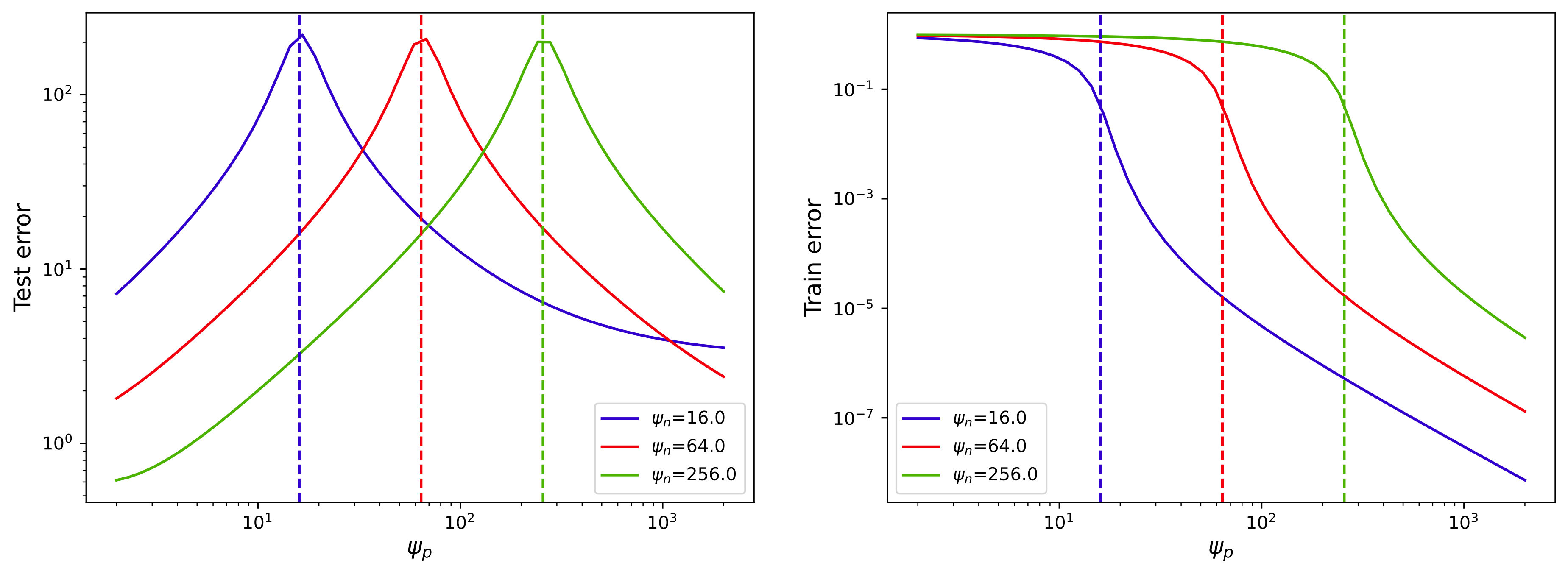

2.3 モデルサイズ p を変える

FID が下がり始める時刻: \tau_{\text{gen}}W=O(1)

訓練データに酷似した生成が始まる時刻: \tau_{\text{mem}}W=O(n)

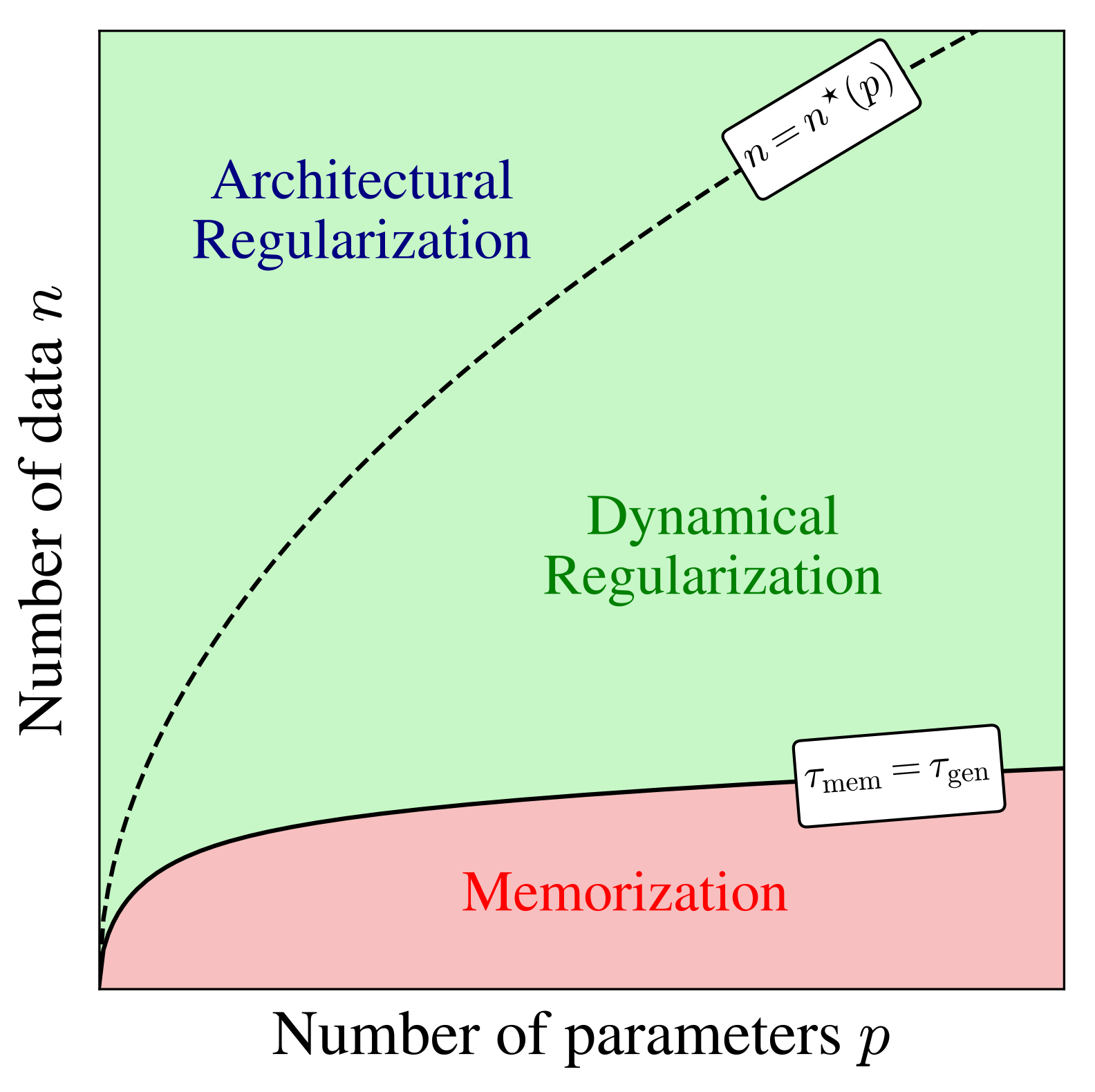

2.4 (p,n) 相図

3 理論パート (Section 3)

ランダム行列の経験スペクトル分布の極限に対するスケーリング解析

- ランダム行列のスペクトル分布解析への帰着 (3.3)

- ランダム行列の Stieltjes Transform Method (3.4)

- 主定理:平均レゾルベントの満たす自己無撞着方程式 (3.6)

- 主補題:Gaussian Equivalence Principle (3.7)

- 証明方針2つ:Replica Method v. Free Probability (3.8)

- 主な系:Two-Bulk 構造 (3.9)

- 結論・ダイナミクスへの示唆:Separation of Timescales (3.10)

3.1 設定

- データ: \mathbb{R}^d\ni x^\nu\overset{\text{i.i.d.}}{\sim}P_x\;(\nu=1,\cdots,n). あとで d\to\infty の極限を考える.

- スコア学習に使うNN:Random Feature W\in\mathbb{R}^{p\times d} with i.i.d. Gaussian s_A(x):=\frac{A}{\sqrt{p}}\sigma^{\otimes p}\left(\frac{Wx}{\sqrt{d}}\right)\qquad A\in\mathbb{R}^{d\times p},

- 損失関数: 固定した時刻 t>0 での DSM loss \mathcal{L}_t(A;\{x^\nu\}_{\nu=1}^n):=\frac{1}{dn}\sum_{\nu=1}^n\operatorname{E}\left[\|\sqrt{\Delta_t} s_A(x_t^\nu(\xi))+\xi\|^2\right].

- 訓練: GD の連続時間極限 \dot{A}_\tau=-d^2\nabla_A\mathcal{L}_t(A_\tau)=-2\Delta_t\frac{d}{p}AU_\tau-\frac{2d\sqrt{\Delta_t}}{\sqrt{p}}V_\tau^\top,\qquad\tau\ge0.

3.2 GD の連続時間極限

DSM loss での勾配降下法: A^{(k+1)}\gets A^{(k)}-\eta\nabla_A\mathcal{L}_t(A^{(k)}),\qquad k=0,1,2,\cdots \mathcal{L}_t(A)=\frac{1}{d}\left(\frac{\Delta_t}{p}\operatorname{Tr}(A^\top AU)+\frac{2\sqrt{\Delta_t}}{\sqrt{p}}\operatorname{Tr}(AV)+d\right)

時間変換 \tau(k):=k\eta/d^2 を施して,\eta\to0 の極限を取ると \dot{A}_\tau=-d^2\nabla_A\mathcal{L}_t(A_\tau)=-2\Delta_t\frac{d}{p}A_\tau U-\frac{2d\sqrt{\Delta_t}}{\sqrt{p}}V^\top,\qquad\tau\ge0, %:=\frac{1}{n}\sum_{\nu=1}^n\E[y^\nu (y^\nu)^\top] U:=\frac{1}{n}\sum_{\nu=1}^n\operatorname{E}_\xi\left[\sigma^{\otimes p}\left(\frac{Wx^\nu_t(\xi)}{\sqrt{d}}\right)\sigma^{\otimes p}\left(\frac{Wx^\nu_t(\xi)}{\sqrt{d}}\right)^\top\right], V:=\frac{1}{n}\sum_{\nu=1}^n\operatorname{E}_\xi\left[\sigma^{\otimes p}\left(\frac{Wx^\nu_t(\xi)}{\sqrt{d}}\right)\xi^\top\right].

3.3 U のスペクトルの分布への帰着

\dot{\textcolor{#E95420}{A}}_{\textcolor{#E95420}{\tau}}=-d^2\nabla_A\mathcal{L}_t(\textcolor{#E95420}{A_\tau})=-2\Delta_t\frac{d}{p}\textcolor{#E95420}{A_\tau} U-\frac{2d\sqrt{\Delta_t}}{\sqrt{p}}V^\top,\qquad\tau\ge0, は行列 A\in\mathbb{R}^{d\times p} に関する線型 ODE.U\in\mathrm{GL}_p(\mathbb{R}) なら Duhamel の公式から \frac{\textcolor{#E95420}{A_\tau}}{\sqrt{p}}=-\frac{1}{\sqrt{\Delta_t}}V^\top U^{-1}+\left(\frac{1}{\sqrt{\Delta_t}}V^\top U^{-1}+\frac{A_0}{\sqrt{p}}\right)\exp\left(-\frac{2\Delta_t}{\psi_p}U\textcolor{#E95420}{\tau}\right), \psi_p:=\frac{p}{d},\qquad\psi_n:=\frac{n}{d}.

A_0=0 と仮定する.

(George et al., 2025) は解 -V^\top U^{-1}/\sqrt{\Delta_t} に注目して,別の道具を通じてスペクトル分布を調べる.

3.4 Stieltjes Transform Method (1/2)

U の経験スペクトル分布 \mu_U の Stieltjes transform は,resolvent R(z):=(U-zI_p)^{-1} の平均固有値が与える: q(z):=\frac{\operatorname{Tr}(R(z))}{p}=\frac{1}{p}\sum_{i=1}^pR(z)_{ii}=\int_{-\infty}^\infty\frac{1}{\lambda-z}\mu_U(d\lambda)\quad(z\in\mathbb{C}\setminus\mathbb{R}).

Resolvent R(z) は \mathrm{Sp}(U) 上の有界 Borel 関数 f(\lambda)=(z-\lambda)^{-1} の E に関する積分.

3.4 Stieltjes Transform Method (1/2)

U の経験スペクトル分布 \mu_U の Stieltjes transform は,resolvent R(z):=(U-zI_p)^{-1} の平均固有値が与える: q(z):=\frac{\operatorname{Tr}(R(z))}{p}=\frac{1}{p}\sum_{i=1}^pR(z)_{ii}=\int_{-\infty}^\infty\frac{1}{\lambda-z}\mu_U(d\lambda)\quad(z\in\mathbb{C}\setminus\mathbb{R}).

Resolvent R(z) は f(\lambda)=(z-\lambda)^{-1} の E に関する積分: R(z)=\frac{1}{U-z}=\int_{\mathrm{Sp}(U)}\frac{1}{\lambda-z}E(d\lambda). \therefore\qquad R(z)_{ii}=(e_i|R(z)e_i)=\int_{-\infty}^\infty\frac{1}{\lambda-z}\mu_{e_i}(d\lambda). \mu_U=\frac{1}{p}\sum_{i=1}^p\mu_{e_i},\qquad \mu_{e_i}(A):=(e_i|E(A)e_i)\quad(A\in \mathcal{B}(\mathbb{R})).

3.5 Stieltjes Transform Method (2/2)

q(z)=\operatorname{Tr}(R(z))/p を求めれば,\mu_U が復元できる:

3.5 Stieltjes Transform Method (2/2)

【証明】 任意の \lambda\in\mathbb{R} について,

\begin{align*} \mathrm{Im}\,\left(\frac{S_\mu(\lambda+i\epsilon)}{\pi}\right)&=\frac{S_\mu(\lambda+i\epsilon)-S_\mu(\lambda-i\epsilon)}{2\pi i}\\ &=\frac{1}{2\pi i}\int_\mathbb{R}\left(\frac{1}{x-(\lambda+i\epsilon)}-\frac{1}{x-(\lambda-i\epsilon)}\right)\,\mu(dx)\\ &=\frac{1}{2\pi i}\int_\mathbb{R}\frac{2i\epsilon}{x^2-2\lambda x+(\lambda^2+\epsilon^2)}\mu(dx)\\ &=\int_\mathbb{R}\frac{1}{\pi}\frac{\epsilon}{(x-\lambda)^2+\epsilon^2}\mu(dx),\qquad\lambda\in\mathbb{R}. \end{align*}

この右辺は実は X\sim\mu,C_\epsilon\sim\operatorname{Cauchy}(0,\epsilon) について X+C_\epsilon の分布の \lambda での確率密度である.X+C_\epsilon\Rightarrow X から結論が従う.

複素解析の Sokhotski-Plemelj の公式 の系ともみれる.

3.6 主定理:平均レゾルベント q(z) の極限の特徴付け

q を記述するための補助的な量(R(z) と W,\Sigma^{-1}W との overlap)を導入:

\scriptstyle r(z):=\frac{1}{p}\operatorname{Tr}(\Sigma^{1/2}W^\top(U-zI_p)^{-1}W\Sigma^{1/2}),\quad s(z):=\frac{1}{p}\operatorname{Tr}(W^\top(U-zI_p)^{-1}W),\quad z\in\mathbb{C}

\sigma=\mathrm{id}_{\mathbb{R}},P_x=N_d(0,I_d) のとき,r=s で s,\hat{s} を消去すると (Marčenko and Pastur, 1967) の自己無撞着方程式を得る: q(z)=\frac{1}{-z+\frac{\psi_p}{1+q(z)}}.

3.7 Gaussian Equivalence Principle

\sqrt{\theta_2(f)} は f(Z_{11}) を Z_{11} で線型回帰した際の係数の絶対値,\theta_1(f)-\theta_2(f) は残差と見れる.

3.7 Gaussian Equivalence Principle

3.7 Gaussian Equivalence Principle

\begin{align*} U&:=\frac{1}{n}\sum_{\nu=1}^n\operatorname{E}_\xi\left[\sigma^{\otimes p}\left(\frac{Wx^\nu_t(\xi)}{\sqrt{d}}\right)\sigma^{\otimes p}\left(\frac{Wx^\nu_t(\xi)}{\sqrt{d}}\right)^\top\right]\\ U'&:=\frac{GG^\top}{n}+b_t^2\frac{WW^\top}{d}+s_t^2I_p,\qquad G:=e^{-t}a_t\frac{W}{\sqrt{d}}X'+v_t\Omega \end{align*}

\sigma^2_x:=\operatorname{Tr}(\Sigma)/d,\;f_t(\xi,\eta):=\sigma(e^{-t}\sigma_x\eta+\sqrt{\Delta_t}\xi)\;\xi,\eta,\zeta\sim\operatorname{N}_1(0,1) とすると \begin{align*} b_t&:=\operatorname{E}[\xi f_t(\xi,\eta)],\qquad a_t:=\operatorname{E}\left[\frac{\eta}{e^{-t}\sigma_x} f_t(\xi,\eta)\right],\\ v_t^2&:=\operatorname{E}[f_t(\xi,\eta)f_t(\xi,\zeta)]-a_t^2e^{-2t}\sigma^2_x,\\ s^2_t&:=\operatorname{E}[\sigma(\Gamma_t\eta)^2]-a_t^2e^{-2t}\sigma^2_x-v_t^2-b_t^2,\qquad\Gamma_t:=e^{-2t}\sigma^2_x+\Delta_t. \end{align*}

3.8 q(z)=\operatorname{Tr}(R(z))/p の極限の計算方法

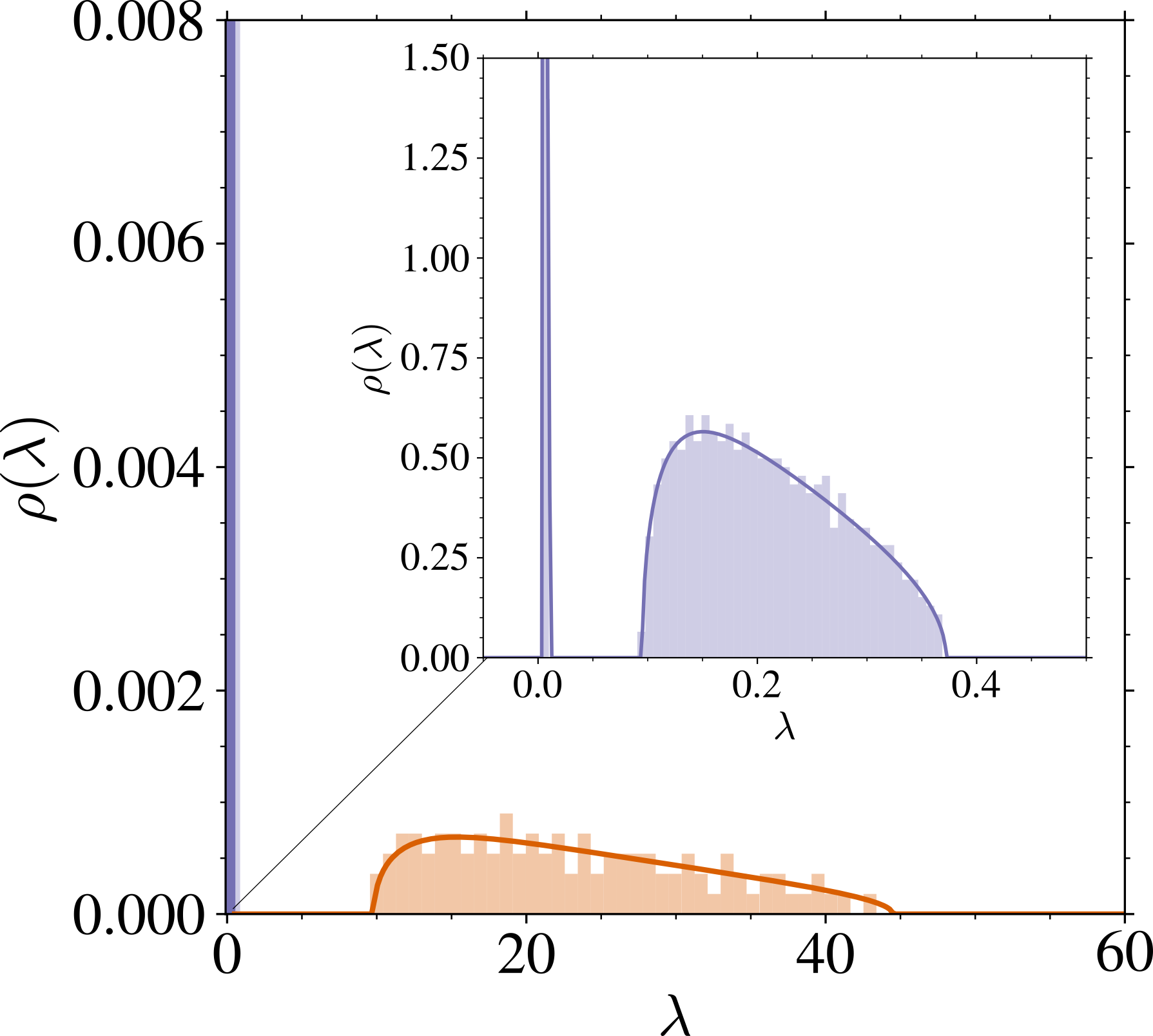

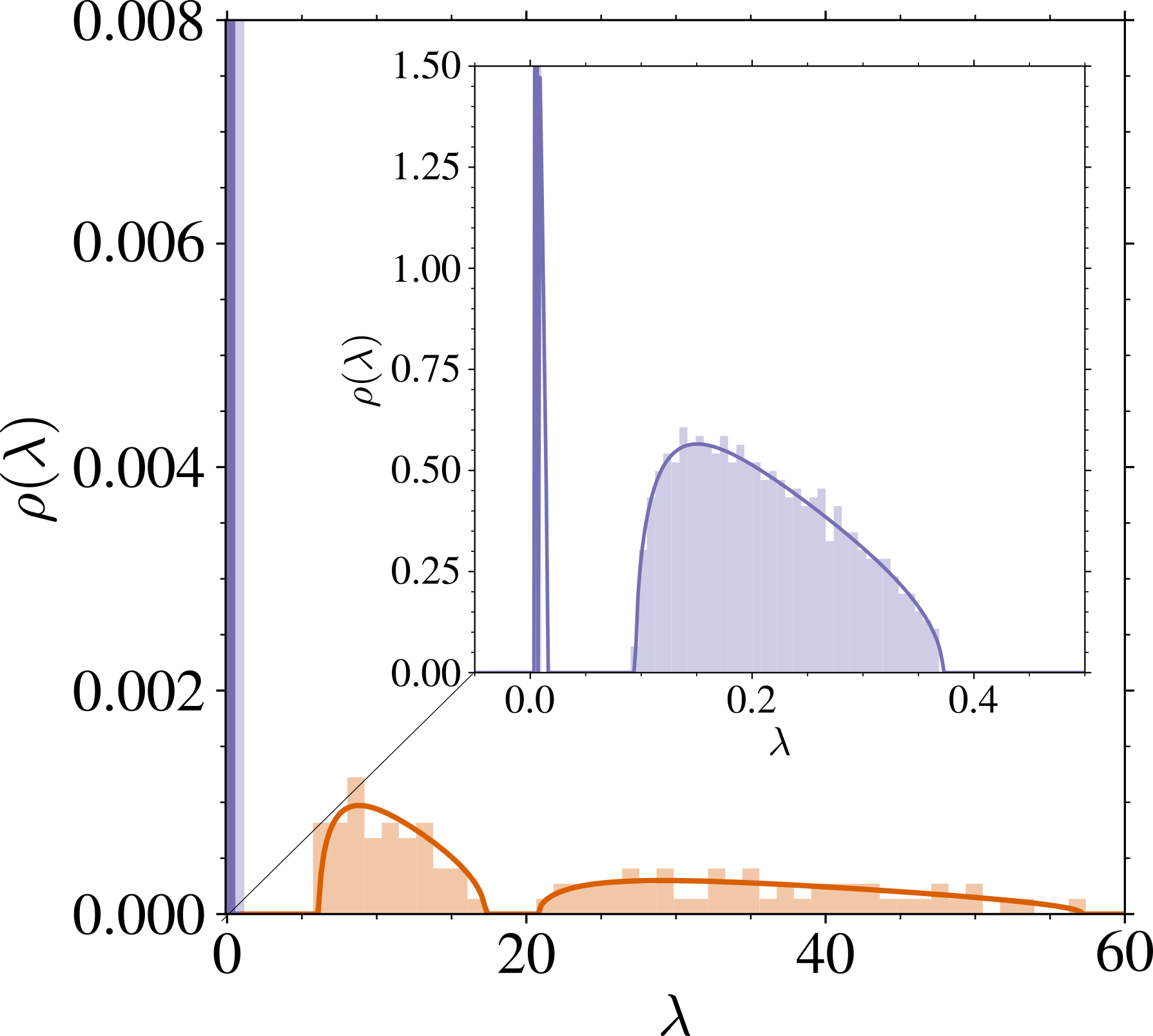

3.9 主な系:スペクトルの two-bulk 構造

証明は \psi_n,\psi_p\to\infty の近似の下で固定点方程式を解くことによる.

3.9 主な系:スペクトルの two-bulk 構造

特に,\psi_p/\psi_n\to\infty も仮定すると,\sup\mathrm{supp}\;(\rho_1)=O(\psi_p/\psi_n).

3.9 主な系:スペクトルの two-bulk 構造

\rho_1 は \sigma^2_x:=\operatorname{Tr}(\Sigma)/d を通じてしかデータに依存しないので,2つの図で変わらない.

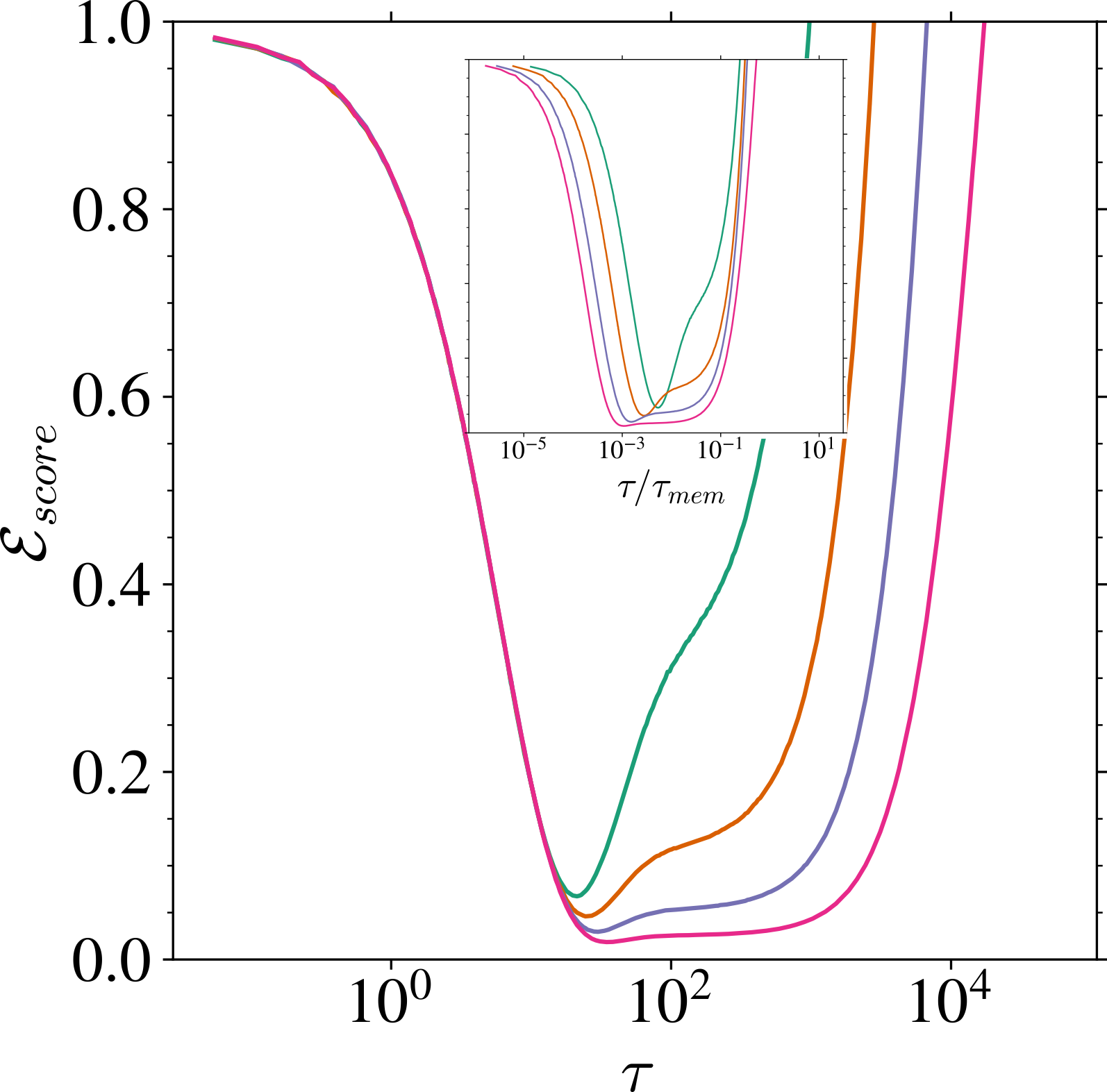

3.10 過剰パラメータ領域での訓練ダイナミクス

\tau_{\text{gen}}:=\frac{\psi_p}{\Delta_t}\inf\mathrm{supp}\;(\textcolor{#E69252}{\mu_{\widetilde{U}}})=O(1/\Delta_t). \tau_{\text{mem}}:=\frac{\psi_p}{\Delta_t}\inf\mathrm{supp}\;(\textcolor{#928EC3}{\rho_1})=O(\psi_n/\Delta_t). t>0 が大きく,n が大きいほど \tau_{\text{mem}} が大きい.

\mathcal{E}_{\text{score}}:=\frac{1}{d}\operatorname{E}_x\biggl[\|s_A(x)-\nabla\log P_x\|^2\biggr]

\tau_{\text{gen}} までの速いスケールでは,汎化ギャプ \mathcal{L}_{\text{gen}}=\mathcal{L}_{\text{test}}-\mathcal{L}_{\text{train}} が消える.

3.11 補足:経験誤差最小化解 \tau\to\infty の汎化誤差

実は収束先も n が大きいほど汎化ギャップ \mathcal{L}_{\text{gen}}=\mathcal{L}_{\text{test}}-\mathcal{L}_{\text{train}} は低くなる (George et al., 2025).

ただし,パラメータ不足領域 \psi_p<\psi_n に侵入した場合は,時間スケールの分離は見られず,architectural regularization により \mathcal{L}_{\text{gen}}=\mathcal{L}_{\text{test}}-\mathcal{L}_{\text{train}} はさらに下がる.

4 まとめ

4.1 学習ダイナミクスのスケール分離

- 学習ダイナミクスのスケール分離を,勾配流の緩和時間 \tau^{-1}=\psi_p\lambda_{\text{min}}/\Delta_t の解析から示した.

- U の固有値分布 \rho(d\lambda) が次を満たす d\to\infty 極限でスケール分離する: \psi_p:=\frac{p}{d}\to\infty,\quad\psi_n:=\frac{n}{d}\to\infty,\quad\frac{\psi_p}{\psi_n}\to\infty.

- 速いスケールは真のデータ分布のみに依存し,\mathcal{L}_{\text{gen}}=\mathcal{L}_{\text{test}}-\mathcal{L}_{\text{train}} が消える

- 遅いスケールは \tau_{\text{mem}}=O(n) のオーダーで,データ分布の \sigma_x^2:=\operatorname{Tr}(\Sigma)/d のみに依存する.

- n も同時に大きくしていくと,経験リスク最小解 \tau\to\infty での \mathcal{L}_{\text{gen}} は下がる

4.2 なぜ学習ダイナミクスにスケール分離が見られるのか?

- NN の spectral bias (Rahaman et al., 2019):NN が関数を学習する際,低周波成分 → 高周波成分の順に学んでいく

- → early stopping と併せると「低周波成分だけを学んでいることが汎化の主な理由である」という仮説がたつ.

- 拡散モデルは訓練データに依らず,高周波成分を縮小して学習する (Kadkhodaie et al., 2024)3

4.3 附言

- GD ダイナミクスだけ? SGD, Adam でも普遍的に観察されるし,説明したい.

- conditional generation でも成り立つように思われ,その場合 n,p,d 以外の変数が出てくる?

- P_x の裾が重い場合はどうなる?部分多様体上に台を持つ場合は?

参考文献

Footnotes

平均 \widetilde{U}:=\operatorname{E}[U] の経験スペクトル分布の極限を \mu_{\widetilde{U}} とした.↩︎

(Kadkhodaie et al., 2024) は denoiser を直接 MSE で学習していることに注意.↩︎